DeepSeek 是由北京深度求索人工智能基础技术研究有限公司推出的人工智能项目。它涵盖大语言模型、代码语言模型以及视觉语言模型等多个领域。其技术亮点众多,如采用混合专家模型(MoE)、多头潜注意力(MLA)机制,运用 FP8 混合精度训练和 GRPO 强化学习方法。具有训练和使用成本低、生成速度快等优势,在推理、数学等领域表现出色,超越了 Llama2 70B。且坚持开源,在 GitHub 等平台开放代码,推动了技术的迭代与发展。

最近的DeepSeek势头正盛,加上被美西方攻击的事件更是把DeepSeek推上了AI界的热度顶流,甚至破圈火遍全球。

虽然官方的在线DeepSeek服务是免费使用的,但是架不住网友的火热访问和境外攻击,导致官方的在线DeepSeek经常无法使用。

好在官方也提供了开源的DeepSeek版本,让广大用户都可以在自己的电脑上本地化部署来使用DeepSeek。

本次站长使用LM-Studio可视化工具来教大家部署DeepSeek R1开源模型。

安装LM-Studio

LM Studio 是一款桌面应用程序,可在 Windows、macOS 和 Linux 系统上运行,能让用户在本地设备脱机运行大型语言模型,具有模型兼容性广、硬件协同优化佳、交互便捷等特点,支持从 Hugging Face 等资源库下载模型,并提供类似 OpenAI API 的本地服务器功能,可用于个人创作、智能客服、学术科研等多种场景。

您可以直接在本文最后的下载地址内下载LM Studio,当然您也可以通过LM Studio官方网站进行下载。

LM Studio官方网站:https://lm-studio.cn/

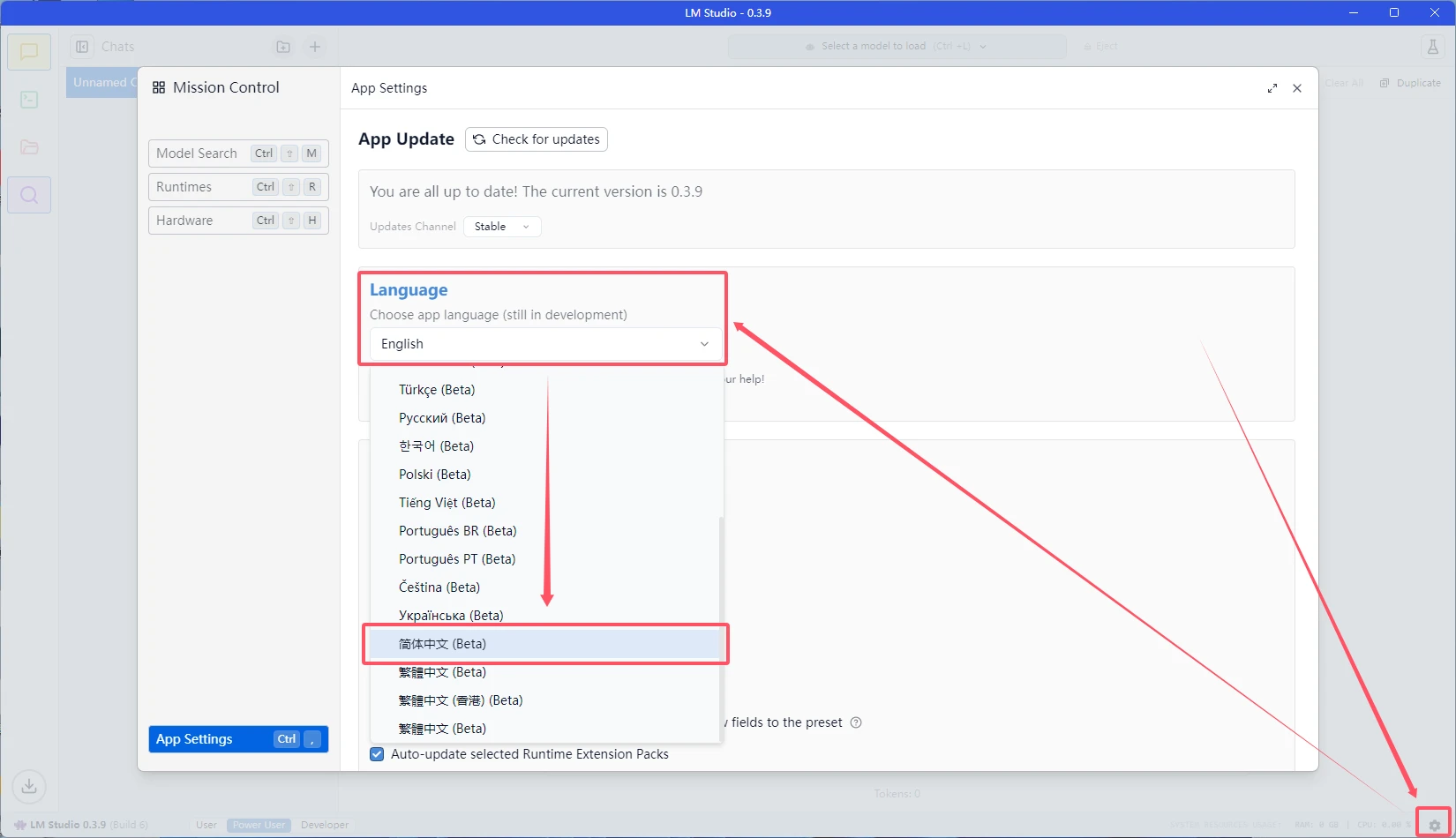

安装完成后第一次打开是英文的页面,先点击右上角跳过介绍界面,再点击右下角的设置图标,找到Language选项选择简体中文即可。

完成这一步后运行DeepSeek的可视化容器就已经完成了,此时的LM Studio还是空的,并没有任何模型,所以我们选择DeepSeek模型添加到LM Studio。

选择DeepSeek模型

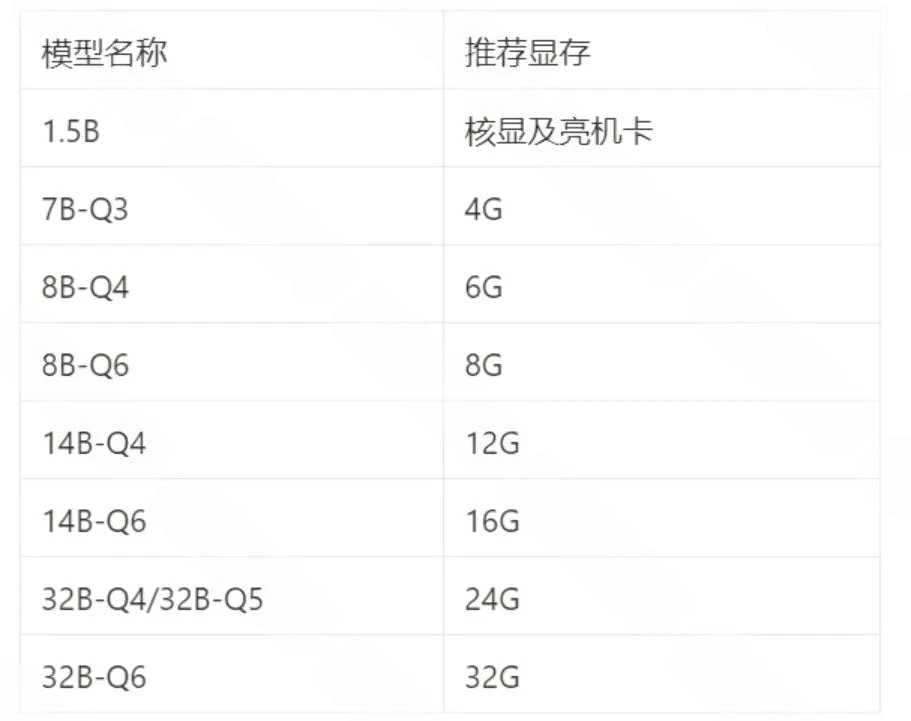

本次站长分享的是DeepSeek R1模型,其中根据电脑的显卡配置性能还分了好多个版本,大家可以根据下面这张表格进行选择。

如果是体验的话,选择1.5B模型就可以了,毕竟性能要求低,绝大部分电脑都可以运行,而且模型文件也比较小。

当然站长也在本文提供了模型下载,请在本文最后的“下载地址”内查看。

导入模型

选择好合适自己的模型下载后,需要将DeepSeek模型导入到LM Studio内。

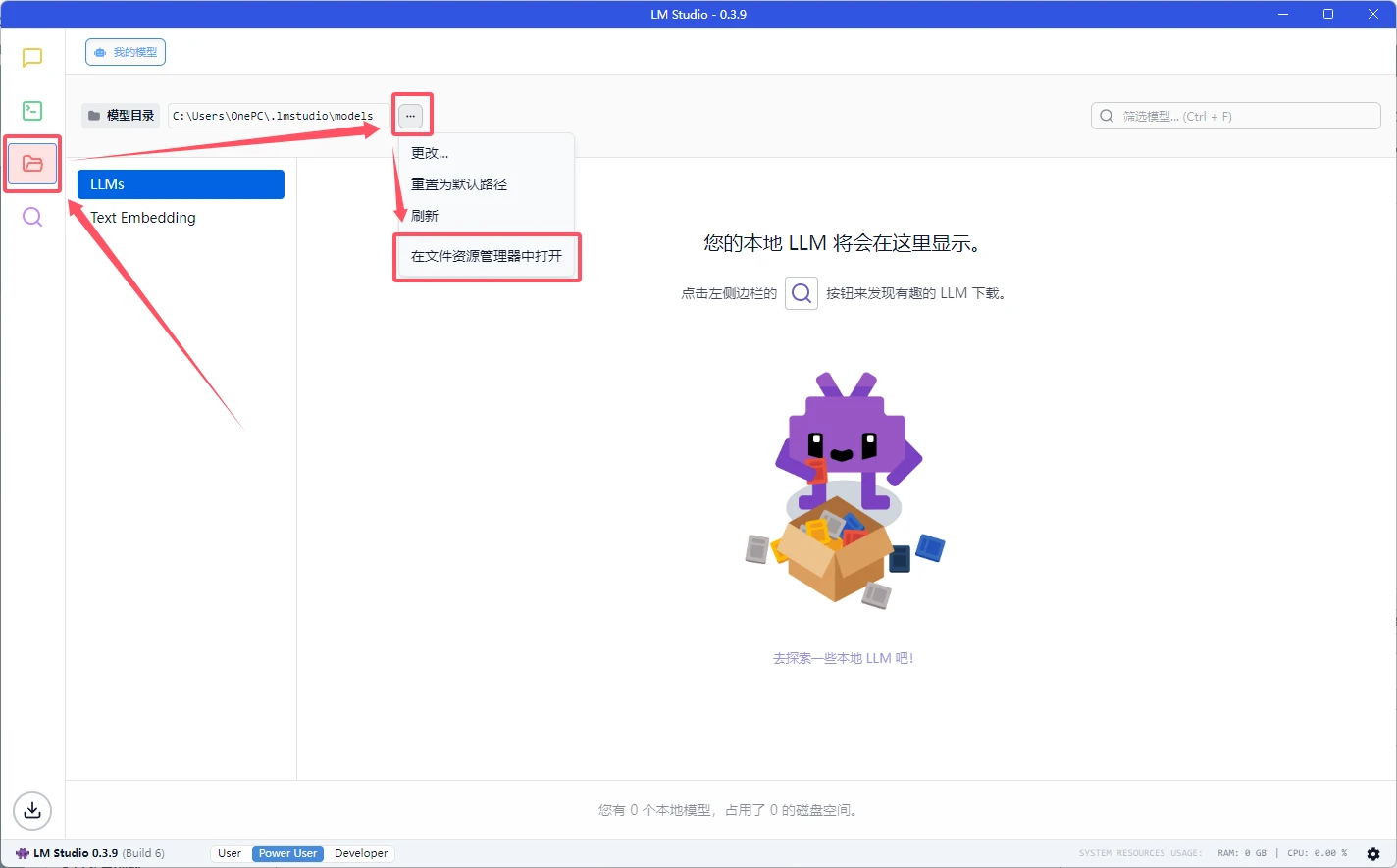

首先打开LM Studio,然后选择左侧导航栏中的“我的模型”选项,在“模型目录”后的更多选择内选择“在文件资源管理器内打开”。

然后将下载的模型文件解压到LM Studio的模型文件夹内。

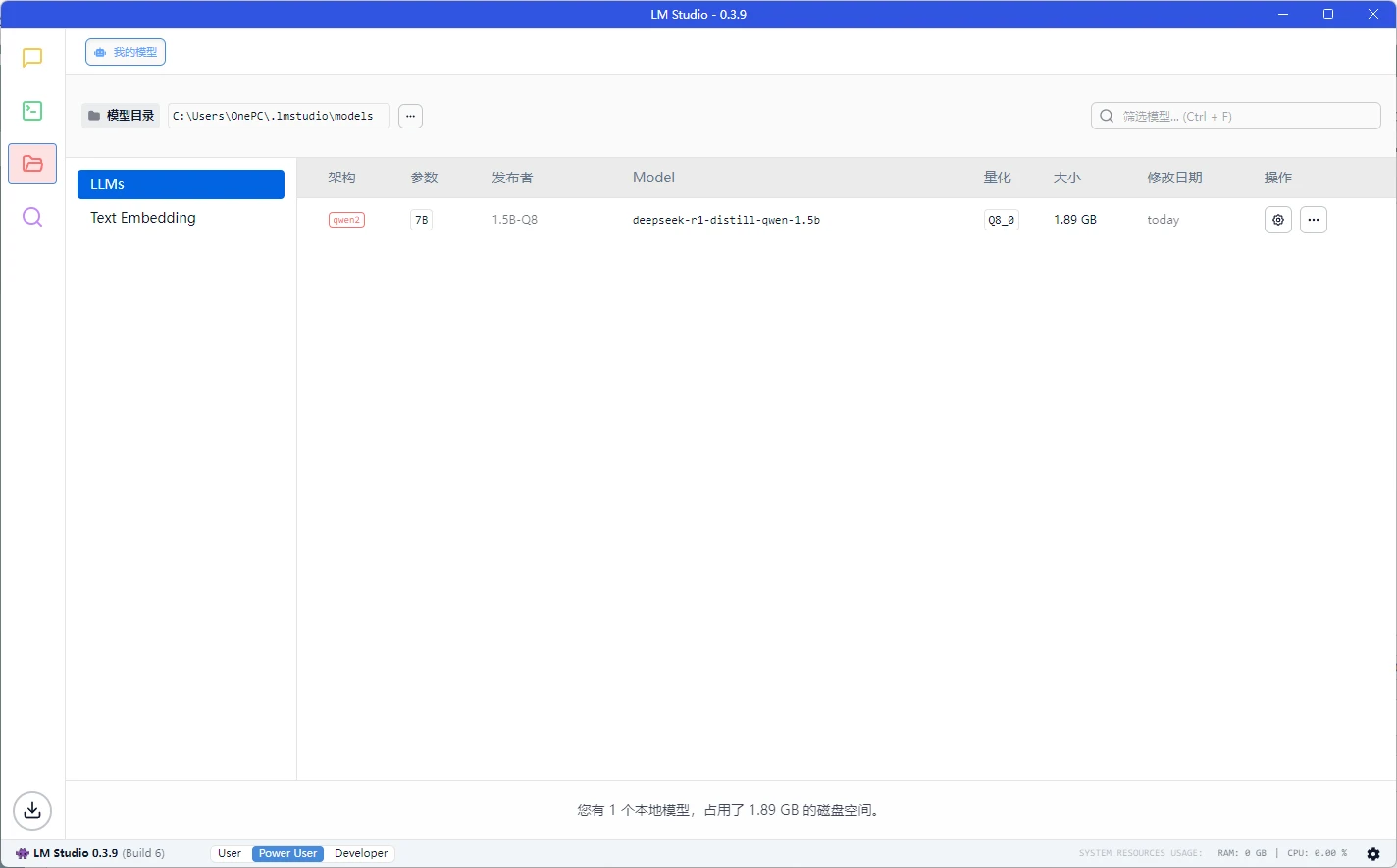

注意:LM Studio的模型文件夹仅支持二级文件目录,不让LM Studio无法检测到DeepSeek模型,可以参考站长下面这张截图。

完成这个步骤后返回LM Studio就可以看到DeepSeek模型了

使用DeepSeek模型

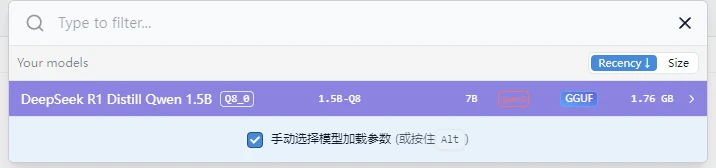

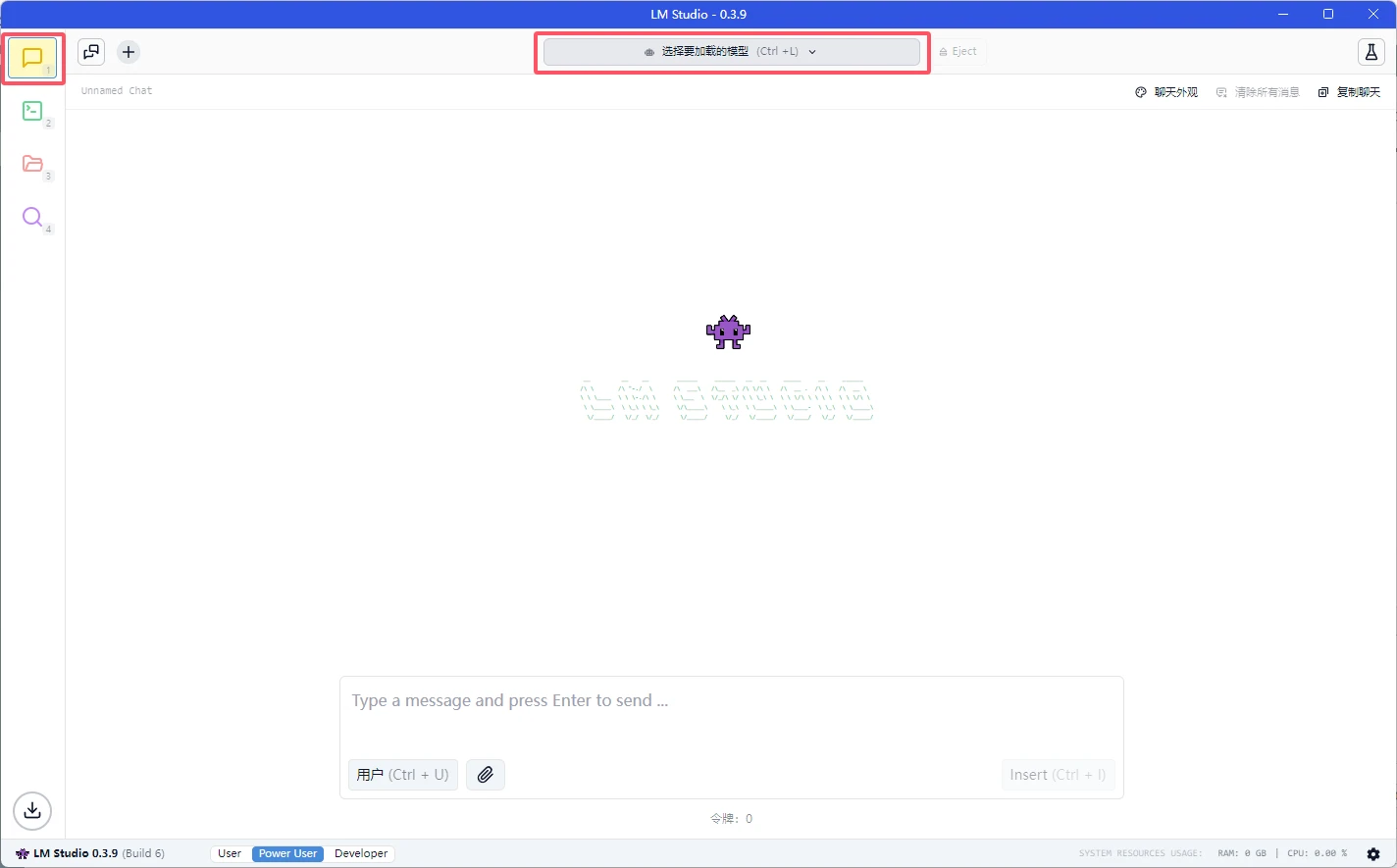

在LM Studio左侧导航栏选择“聊天选项”,点击界面中间的“选择要加载的模型”选项,根据提示完成选择DeepSeek R1 1.5B模型即可

您可以根据自己的需求和电脑配置性能自定义参数,完成后点击“加载模型”就完成全部的DeepSeek模型的本地化部署操作了!

接下来就能体验传说中的DeepSeek模型了。

使用DeepSeek模型

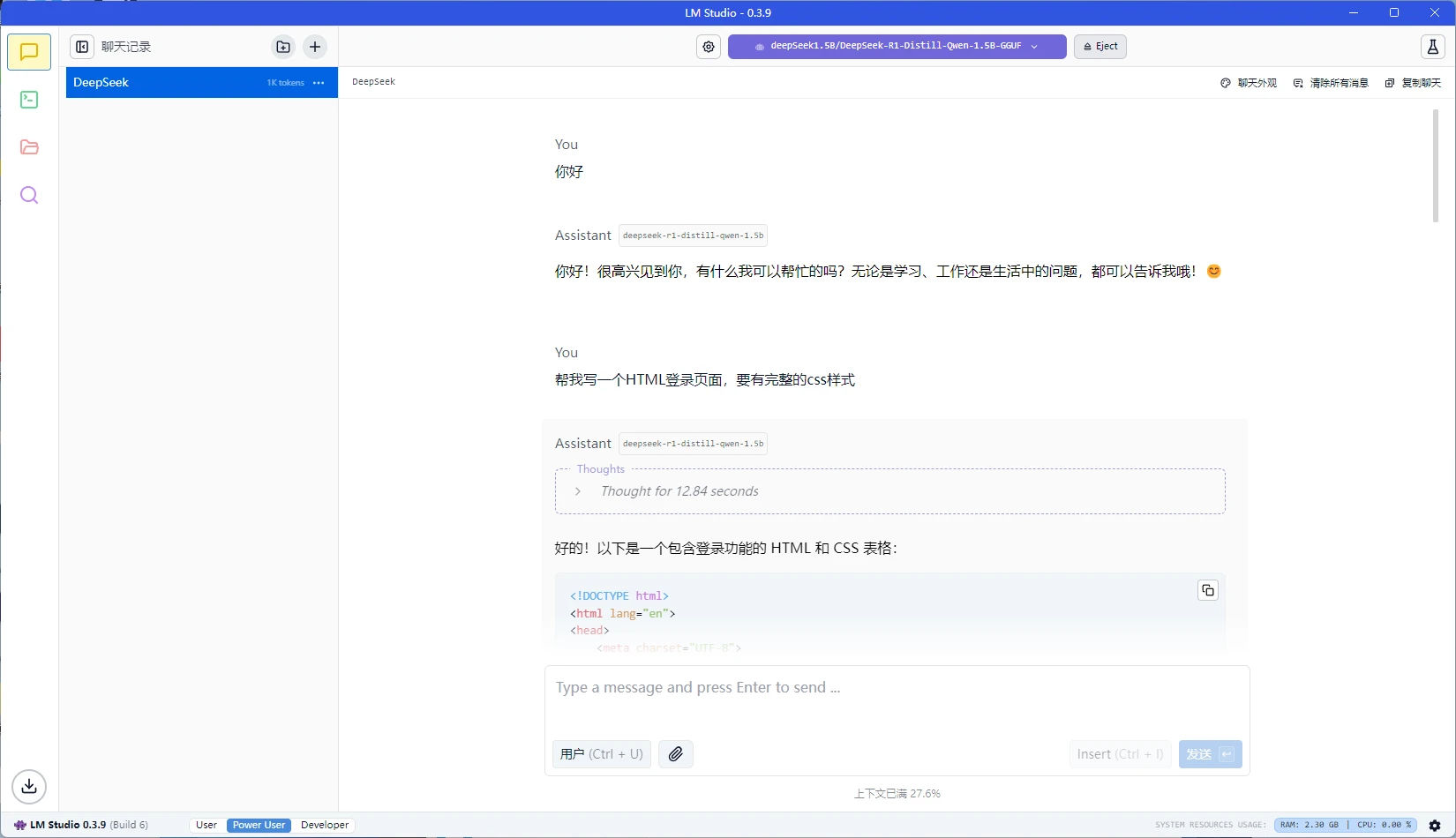

在聊天框内输入内容就可以愉快的进行使用体验啦!

站长体验了DeepSeek 1.5B的模型,用它帮我生成了一个HTML前端登录页面 ,感觉响应速度还行。

下载地址

DeepSeek R1

来源:初春云盘